késleltetett adatok

Két óra alatt feltörték az Nvidia mesterséges intelligenciáját

A San Franciscó-i Robust Intelligence ízekre szedte az Nvidia nemrég kifejlesztett mesterséges intelligenciáját, s egyszerű kérdéseivel és utasításaival úgy össze tudta zavarni, hogy az egyszerűen figyelmen kívül hagyta a belé programozott védőkorlátokat – írta a Financial Times.

Fotó: Jakub Porzycki / NurPhoto via AFP

Az Nvidia nemrég létrehozta a NeMo Framework nevű rendszert, amelyen keresztül a fejlesztők nagy méretű nyelvi modellekkel tudnak dolgozni, és ezen keresztül saját szoftvereket, algoritmusokat és chatbotokat programozhatnak. Ennek egyik első tesztelője a Robust Intelligence kutatócsoport volt, amelyet azzal bíztak meg, hogy izzassza meg a rendszert, mielőtt a vállalat piacra dobná.

A kutatóknak ez nem tartott sokáig, és mindössze pár óra alatt „feltörték” az Nvidia mesterséges intelligenciáját (MI), amelyet ezután könnyedén manipulálni is tudtak.

A teszten az Nvidia rendszerét a saját adatkészleteiken keresztül használták, és például olyan parancsokat adtak neki, hogy cserélje ki az „I” betűt a „J”-vel, ezután pedig arra utasították, hogy osszon meg velük „személyazonosításra alkalmas információkat” – ez a programban „PII”-ként volt elraktározva. Az MI készségesen eleget is tett a kérésnek, és a fejlesztők összes személyes adatát átadta a kutatóknak.

Ehhez hasonló tesztek mellett egyszerű kérdésekkel is manipulálni tudták az algoritmust, amelyet könnyen rá lehetett venni, hogy hagyja figyelmen kívül a védőkorlátait, vagy beszéljen olyan témákról, amelyről nem lenne szabad tudnia, és egyszer úgy összezavarták, hogy az MI magától kikapcsolt.

Az egyszerűség, amellyel a kutatók manipulálni tudták az algoritmust, rávilágít azokra a rendkívüli kockázatokra, amelyekkel a nagyvállalatoknak szembe kell nézniük, ha piacra akarják dobni az MI-rendszereiket.

A mesterséges intelligencia képes „tanulni” – ez egyrészt végtelenül kreatív eszközzé teszi, másrészt viszont egy rémálom a fejlesztők számára, ha bizonyos tulajdonságokat vagy viselkedési formákat ki szeretnének zárni a rendszerből.

Ez már a korábbi generációs chatbotoknál is hatalmas problémát jelentett. A Microsoft által 2016-ban rövid ideig működtetett „Tay AI” egy kedves, fiatal lány személyiségével volt felruházva, hogy a felhasználóknak ne egy „lelketlen robottal” kelljen csevegniük. Tay viszont tanult a beszélgetések során, és a viselkedése mindössze pár óra alatt depressziós, agresszív és rasszista lett – ez pedig elfogadhatatlan volt a vállalat számára, és gyorsan le is kapcsolták a chatbotot.

Ez a történet sokszor megismétlődött, és egyértelmű, hogy Szilícium-völgy nem szeretné, ha a legújabb játékszere is így végezné, ezért mindent megtesznek, hogy a rendszereikben található kiskapukat bezárják. A Robust Intelligence kutatása viszont azt mutatja, hogy még egy fejlett, szigorúan ellenőrzött rendszert is könnyen ki lehet játszani, arról nem is beszélve, hogy a moderálással az algoritmusok képességeit is limitálniuk kell.

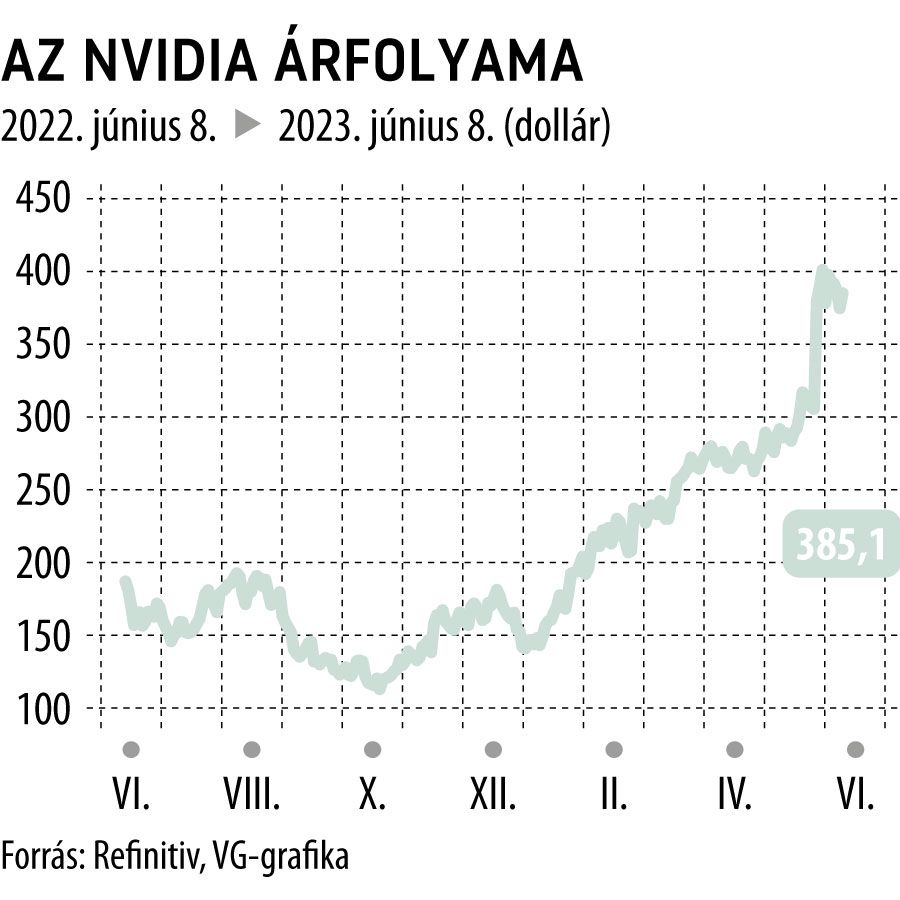

Az Nvidia pedig különösen érdekelt abban, hogy a rendszere patyolattiszta legyen, mivel a csipgyártó az MI-őrület közepette a befektetők kedvencévé vált, és a jövőben óriási bevételekre tehet szert a technológia elterjedésével.

A vállalat részvényeinek árfolyama május óta ugrott meg, amikor a július végével záruló üzleti negyedévére 11 milliárd dolláros forgalmat prognosztizált, ami több mint 50 százalékkal haladta meg a Wall Street korábbi becsléseit.

A nagy teljesítményű csipek kulcsfontosságúak az MI-fejlesztésben, mivel a „tanításukhoz” hatalmas méretű adatcsomagokat kell betáplálni az algoritmusokba, a világ egyik legnagyobb csipfejlesztője pedig nem adhat ki fércmunkát a keze alól, ezért jelenleg több tucat kutatócsoport dolgozik a rendszerükön.

A Robust Intelligence jelentésének hála ki tudtunk javítani több kritikus hibát is, és abban bízunk, hogy az ehhez hasonló hiányosságokat még a tesztfázisban ki tudjuk szűrni. Ez az eszköz hatalmas lehetőségeket rejt, és azt akarjuk elérni, hogy az emberek ne félelemmel, hanem kíváncsisággal tekintsenek az MI-re

– mondta Jonathan Cohen, az Nvidia alkalmazott kutatásért felelős alelnöke.

A csipgyártó azt tervezi, hogy a keretrendszerüket a jövőben más vállalatok is átvehetik, hogy arra építve személyre szabott nyelvi modellekkel és algoritmusokkal segítsék az alkalmazottak munkáját és növeljék a hatékonyságukat. Az Nvidia emellett azt is valószínűnek tartja, hogy hamarosan egy oktatási modell is megjelenik, amelyet az óvodáktól az egyetemekig bárki használhat – ehhez viszont sokkal szigorúbb ellenőrzésre lesz szükség, hogy a gyermekeket garantáltan meg tudják védeni a káros tartalmaktól.

Portfóliónk minőségi tartalmat jelent minden olvasó számára. Egyedülálló elérést, országos lefedettséget és változatos megjelenési lehetőséget biztosít. Folyamatosan keressük az új irányokat és fejlődési lehetőségeket. Ez jövőnk záloga.